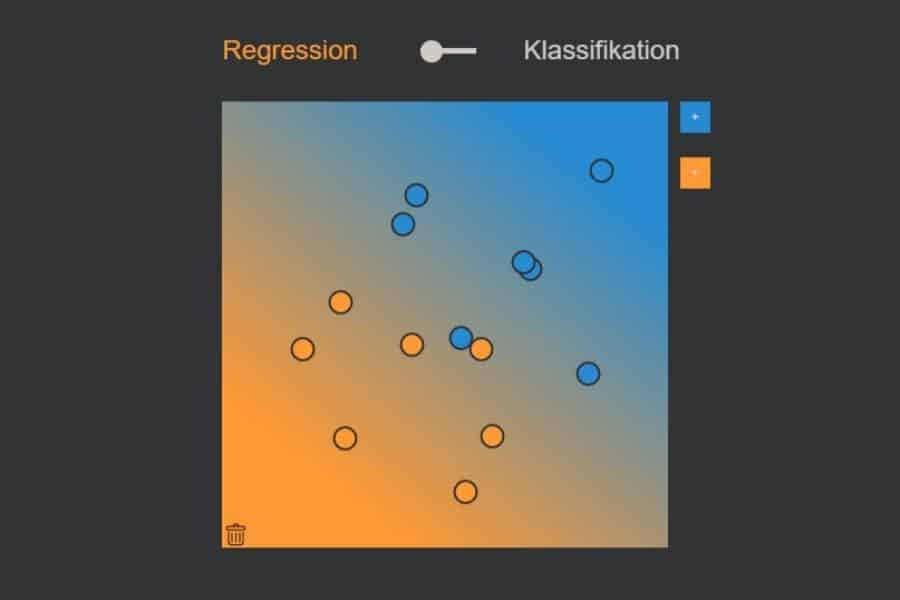

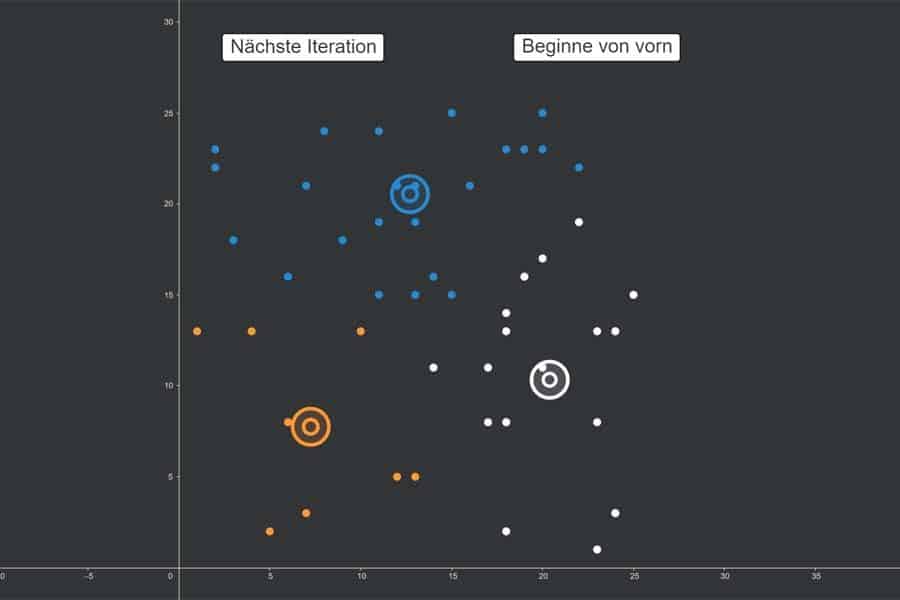

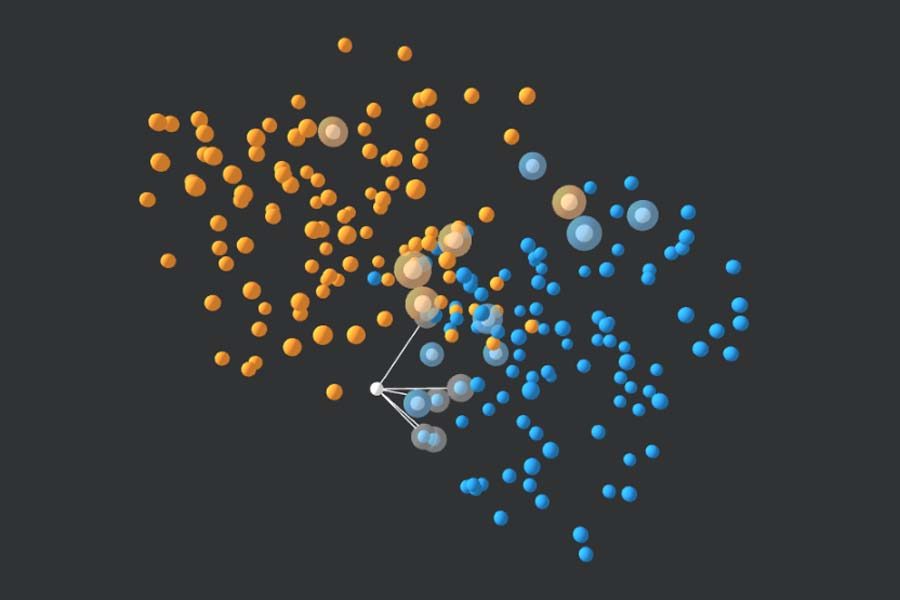

kNN-Algorithmus: Was wird blau, was orange?

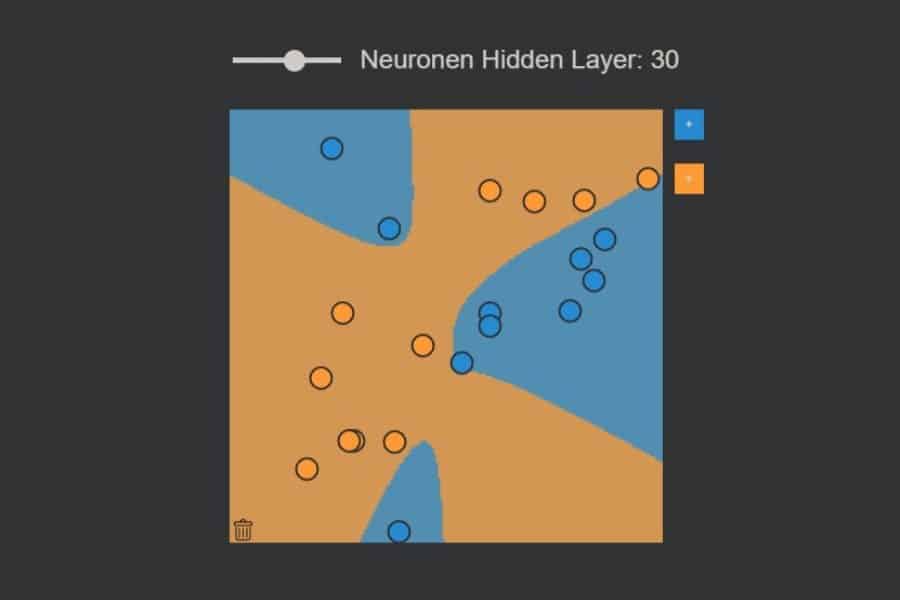

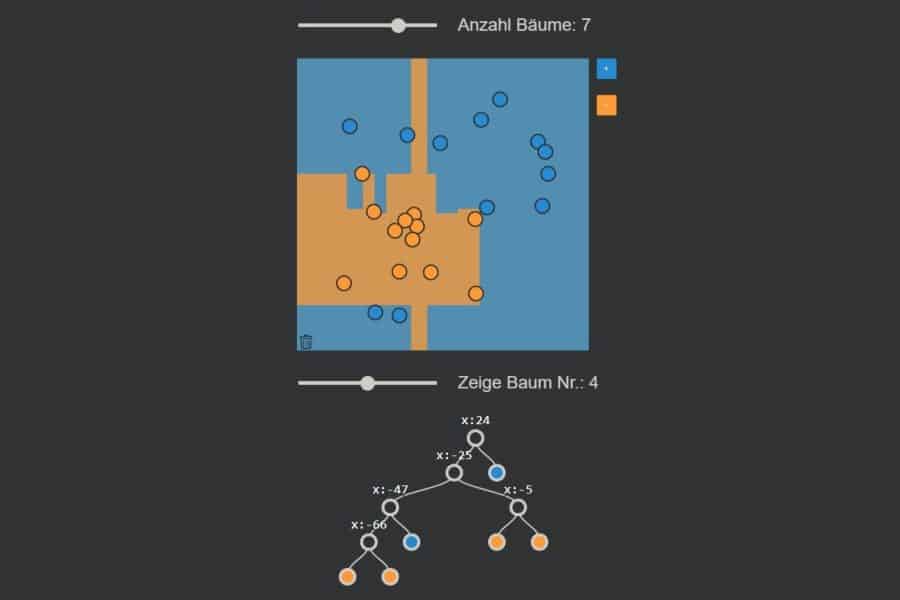

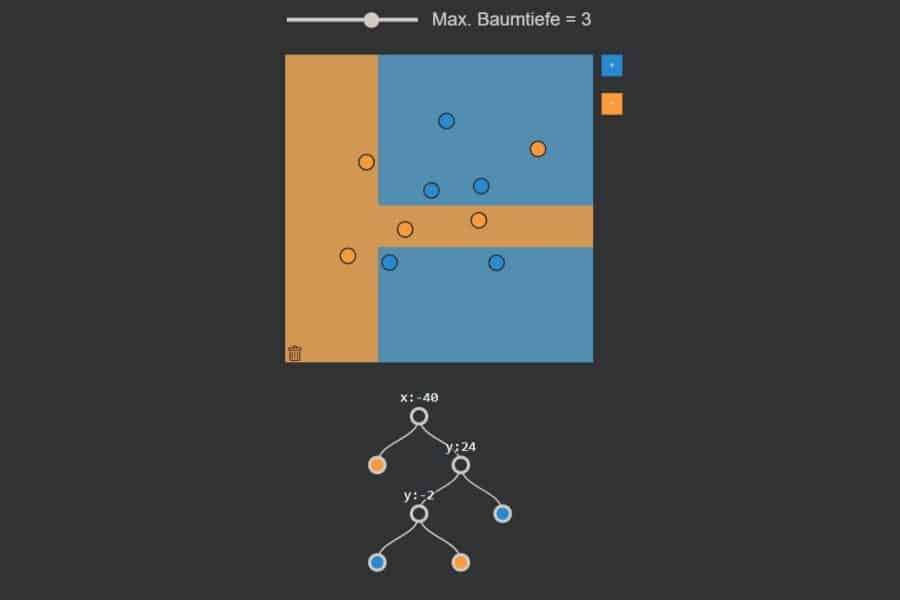

Random Forests sind maschinelle Lernverfahren, die auch als „Ensemble-Verfahren“ bezeichnet werden. Hierbei wird statt nur eines einzelnen Entscheidungsbaums eine ganze Gruppe solcher Bäume trainiert („Wald“). Zur Klassifikation einer Eingabe wird diese in jedem Baum ausgewertet. Diejenige Klasse, die am häufigsten gewählt wurde, ist die Ausgabe des Random Forest. Warum sieht nicht jeder Baum gleich aus? Das liegt daran, dass für jeden Baum zufällig nur eine (zufällig mit Zurücklegen gezogene) Teilmenge der gesamten Trainingsdaten als Trainingsgrundlage verwendet wird (so genanntes „Bootstrapping“). Außerdem wird für jeden Baum nur eine jeweils zufällig gewählte Anzahl der Inputfaktoren (Features) verwendet (hier: entweder der x-Wert oder der y-Wert).

Interaktiv: K-Nearest-Neighbours-Algorithmus in Aktion