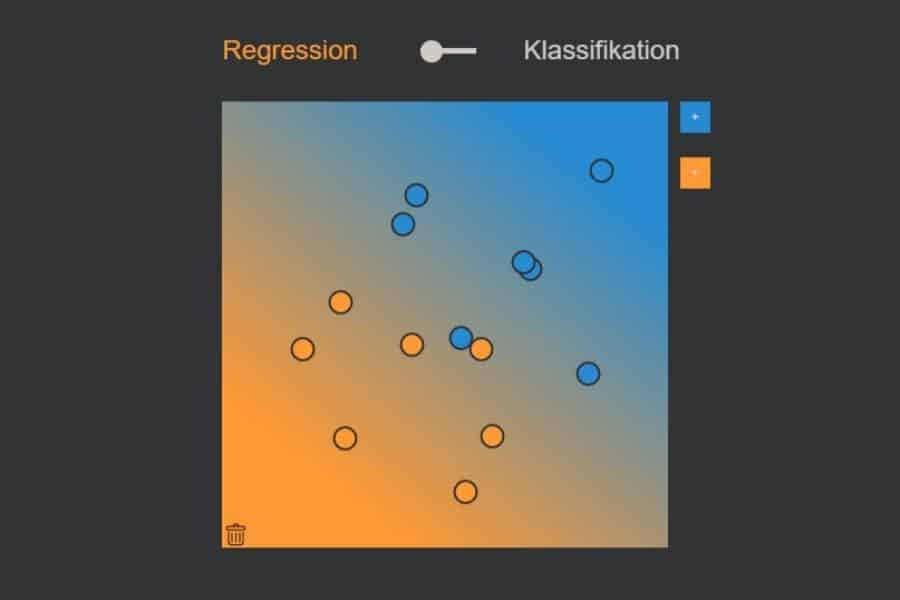

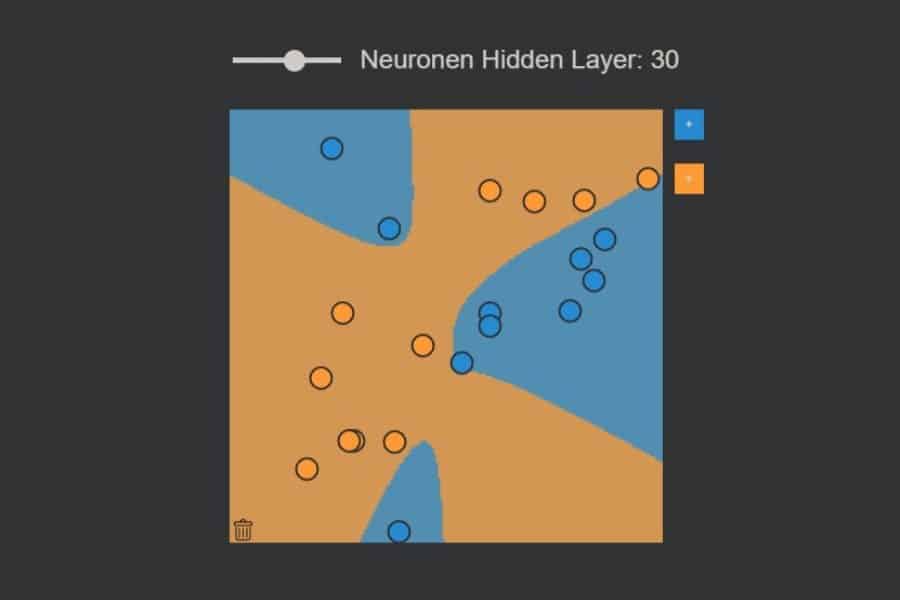

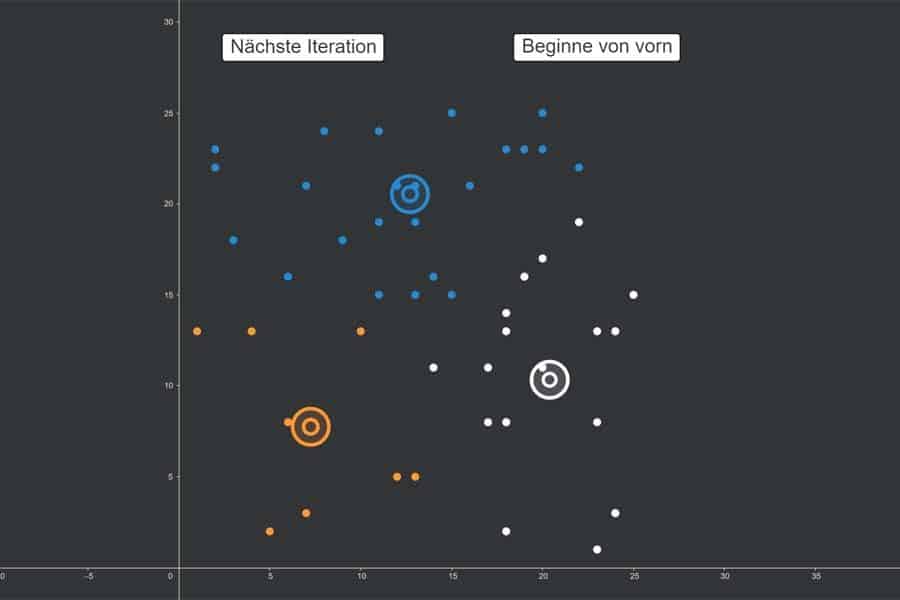

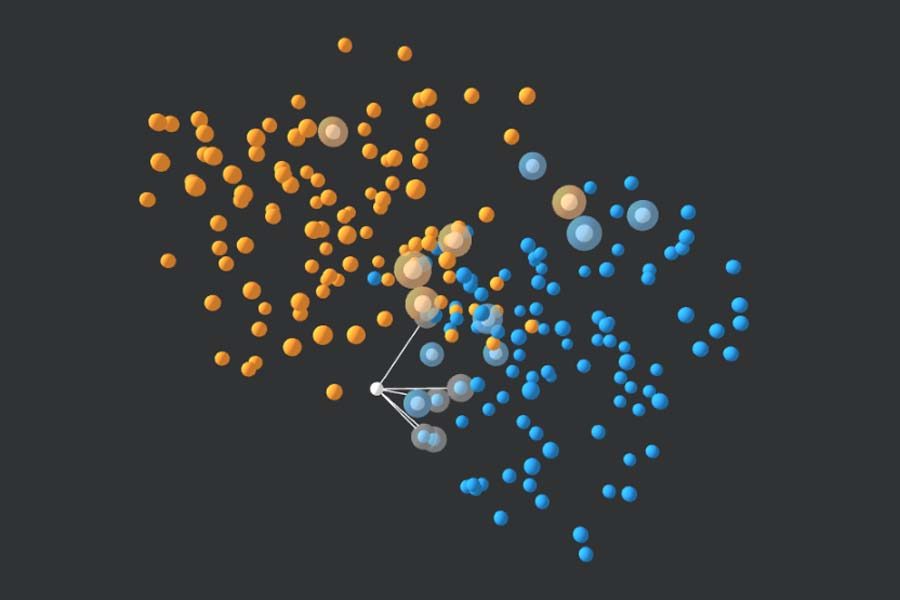

kNN-Algorithmus: Was wird blau, was orange?

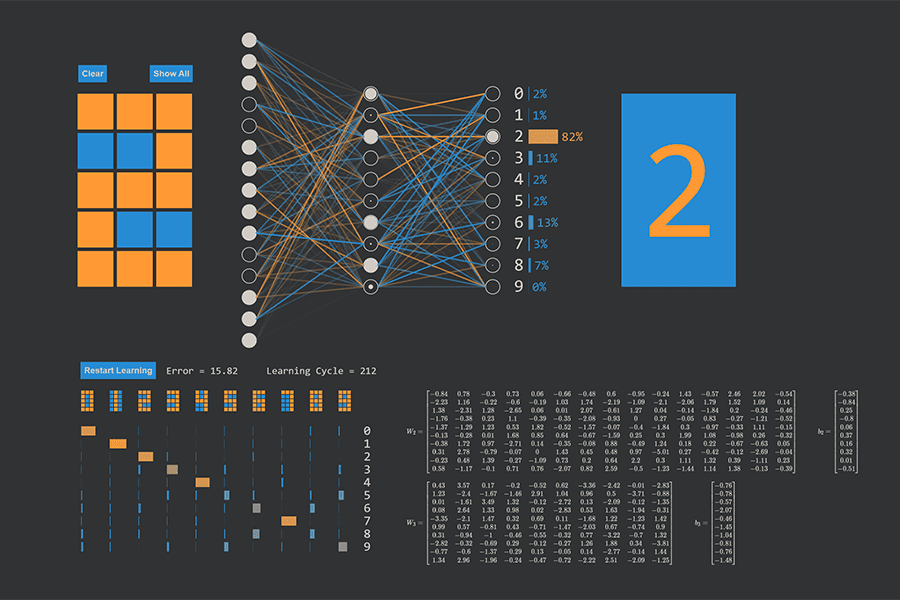

Die App visualisiert ein einfaches neuronales Netz – wie es lernt und wie es arbeitet – am Beispiel der Erkennung handgeschriebener Ziffern. Diese können mit der Maus live auf ein einfaches Zeichenfeld bestehend aus 5 x 3 Pixeln geschrieben werden. Die geschriebene Ziffer wird vom neuronalen Netz dabei unmittelbar in die erkannte Ziffer übersetzt. Wie gut das gelingt, hängt davon ab, wie gut das neuronale Netz trainiert ist.

Das Training erfolgt in der App ebenfalls live in Form von iterativen Lernzykeln. In diesen wird sukzessive der Gesamtfehler verringert, der sich aus dem Vergleich der zehn Trainingsziffern in Pixeldarstellung und der zugehörigen erkannten Ziffer ergibt. Hierbei wird das sogenannte Gradientenverfahren verwendet, welches die Parameter des neuronalen Netzes in jedem Schritt so anpasst, dass der verbleibende Gesamtfehler in jedem Schritt möglichst stark verringert wird („Schritt in Richtung des steilsten Abstiegs im Fehlergebirge“). Das Gradientenverfahren wird effizient durch den „Backpropagation-Algorithmus“ umgesetzt, ein fast magisches Konzept, welches die Leistungsfähigkeit neuronaler Netze begründet.

Wer mehr dazu wissen will, dem sei das hervorragende Online-Buch Neural Networks and Deep Learning empfohlen, das die Funktionsweise neuronaler Netze ausführlich und gut verständlich erklärt.

Interaktiv: K-Nearest-Neighbours-Algorithmus in Aktion